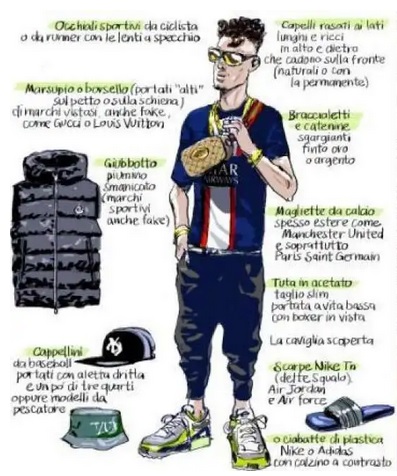

Si fa un gran parlare dei maranza, bulli aggressivi aggregati in temibili baby gang, che si sono moltiplicati a dismisura tramite il social TikTok a partire dal 2019. Si sono diffusi usando la rete ferroviaria di Monza e della Brianza, aggredendo, rapinando e portando devastazione. Il nome di questa subcultura giovanile è stato connotato dal punto di vista etnico, essendo composta in gran parte da giovani nordafricani, soprattutto maghrebini. Va comunque precisato che le origini dei maranza sono anteriori alla formazione delle nuove generazioni di immigrati extracomunitari: esistevano già nell'ultimo decennio dello scorso secolo e a quell'epoca non era percepita alcuna caratteristica etnica extra-italiana.

Secondo alcuni (opinionisti, giornalisti, influencer und ähnliche Parasiten), il termine maranza sarebbe un collettivo in -anza (derivato da un originario astratto). Questa ipotesi, che ricorre con grande insistenza nei media, mi pare piuttosto labile, come credo di poter dimostrare con solidi argomenti. Si rende necessario analizzare la questione in maggior dettaglio.

Ipotesi sull'origine del suffissoide -anza:

Associazione a formazioni colloquiali tipicamente milanesi come riccanza "gente ricca", figanza "atteggiamento da figo", divertanza "divertimento".

Obiezioni:

- Diverso genere grammaticale: Si dice il maranza, i maranza, contro la riccanza (es. "qui c'è tanta riccanza").

- Diversa fonologia: La parola maranza ha un'affricata sonora /dz/ anziché sorda /ts/. Rima con manza. Non rima con danza. La consonante sonora viene in genere attribuita a un'influenza meridionale, anche si il vocabolo è settentrionale.

Ipotesi sull'origine della radice mar-:

1) Associazione al termine paninaresco tamarro "zotico, cafone (soprattutto meridionale)".

Link:

Supposta trafila:

*tamarranza > maranza

Obiezioni:

- Diverso genere grammaticale: Si dice il maranza, i maranza, mentre *la tamarranza avrebbe dato un femminile.

- Diversa fonologia: La parola maranza ha un'affricata sonora /dz/ anziché sorda /ts/. Rima con manza. Non rima con danza. La consonante sonora viene in genere attribuita a un'influenza meridionale, anche si il vocabolo è settentrionale.

- Problemi di cronologia: Nella canzone di Jovanotti Il capo della banda (1988) è presente la prima attestazione nota del termine maranza, che è nettamente distinto dal più comune tamarro:

"Mi chiamo Jovanotti e sono in questo ambiente

Di matti, di maranza e di malati di mente

Fissati con le moto e coi vestiti americani

Facciamo tutto ora o al massimo domani"

Se maranza fosse derivato da *tamarranza, lo sviluppo non si sarebbe potuto verificare contemporaneamente alla diffusione di tamarro: sarebbe stato necessario un lungo periodo di incubazione e di usura della pronuncia. Invece Jovanotti mostra il vocabolo maranza, pronunciato /ma'randza/, come contemporaneo a tamarro, senza alcuna consapevolezza di un'etimologia comune delle due voci.

2) Associazione a Marocco, marocchino, Marrakesh. Supposta trafila:

*maroccanza > maranza

*marocchinanza > maranza

*marrakeshanza > maranza

Obiezioni:

- Diverso genere grammaticale: Si dice il maranza, i maranza, mentre *la maroccanza e simili avrebbero dato un femminile.

- Diversa fonologia: La parola maranza ha un'affricata sonora /dz/ anziché sorda /ts/. Rima con manza. Non rima con danza. La consonante sonora viene in genere attribuita a un'influenza meridionale, anche si il vocabolo è settentrionale.

- Problemi semantici: Nei tardi anni '80 e negli anni '90 del XX secolo, i maranza non erano affatto marocchini, erano tamarri italici.

3) Possibile derivazione da malanza "male" (sostantivo), intendendo "cattiva stirpe", "cattivo seme" o simili.

Origine: male + -anza

Alterazione della pronuncia:

a) rotacismo /l/ > /r/;

b) sonorizzazione /ts/ > /dz/

Supposta trafila:

/ma'lantsa/ > /ma'randza/

Possibili cause dell'alterazione:

a) pronuncia meridionale;

b) influenza dialettale (?);

c) problemi di udito (?).

Obiezioni:

- Arcaismo del termine: In italiano standard non è presente la parola

malanza "male" (sia fisico che morale), che è considerata obsoleta. Il Grande dizionario della lingua italiana (UTET) riporta il

lemma come antiquato e fornisce i seguenti un esempio tratto da Iacopone da Todi (tra il 1230 e il 1236 - 1306):

longo tempo gridammo al messia / che reguarisse la nostra malanza / ed ecco, nudo iace en ella via / e null'è che de lui aia pietanza! Rohlfs considera malanza una derivazione dovuta a influsso gallo-romanzo. Non si riesce a capire attraverso quale percorso tortuoso la parola possa essere giunta in una subcultura degli anni '80 e '90 del XX secolo, notoriamente ostile allo studio!

- Improbabilità dell'alterazione: Se è già improbabile che un termine arcaico come malanza sia riemerso dopo secoli tra gente di un'ignoranza belluina, ancor più improbabile è che a questa ricomparsa si siano associate due cambiamenti nella pronuncia.

Altre ipotesi:

i) Derivazione da maranzana "melanzana", supposto termine meridionale, che sarebbe stato poi abbreviato colloquialmente in maranza. Il motivo dell'epiteto sarebbe la connotazione razzista, essendo la pelle dei maghrebini piuttosto scura.

Semantica:

persona dalla pelle scura (nordafricano) > melanzana > maranza

Supposta trafila:

*maranzana > maranza

Obiezioni:

- Sospetta falsità dell'informazione: Ciò che è riportato nel Web sul maranza-melanzana, è in buona sostanza una fake news. Il termine maranzana è piemontese (variante: marzan-a) e non sembra essere meridionale.

Queste sono invece le forme in uso nel Meridione per dire "melanzana", e sono tutte piuttosto diverse dal supposto maranza(na), con un paio di possibili eccezioni in Puglia:

Napoli, Campania: mulignana

Sicilia: mulinciana, milunciana, mulunciana,

mirinciana

Puglia: marangiana, maranciana, melangiane,

mulangéne

Basilicata: merlingiana

Calabria: lumingiana, malangiana, mulingiana,

melangiana

Nell'italiano regionale meridionale si ha melenzana.

Nota:

Mi sono imbattuto nella parola maranza "arancia", attribuita al siciliano; tuttavia sono stato in grado di reperire soltanto arancia, aranciu e purtuallu.

Link:

- Problemi semantici: Nei tardi anni '80 e negli anni '90 del XX secolo, i maranza non erano affatto marocchini, erano tamarri italici.

ii) Etimologia paninara: parola macedonia derivata da marocchino + zanza

Supposta origine del secondo elemento della parola macedonia:

Riduzione di una forma verbale. In gergo paninaro zanzare significa "tagliare"; "scippare (tagliando la cinghia della borsa)". Ho potuto attestare la locuzione zanzare via "recidere". La pronuncia è /dzan'dzare/, con due affricate sonore: è un omofono del plurale di zanzara.

Nota:

Secondo alcuni navigatori, in romagnolo zanza significherebbe "furbo". Non sono stato in grado di confermare la glossa.

Supposta trafila:

*marocchino-zanza > *marocco-zanza > *maroccanza > maranza

Nota:

Erano chiamati zanza gli appartenenti a una subcultura tipicamente milanese, formatasi dopo l'estinzione dei Paninari.

Obiezioni:

- Problemi semantici: Nei tardi anni '80 e negli anni '90 del XX secolo, i maranza non erano affatto marocchini, erano tamarri italici.

iii) Possibile etimologia: maranza è una pura e semplice alterazione espressiva del romanesco coatto maranga, maranca "teppistello".

Link:

Nota:

Non mi risulta che questa ipotesi, che mi era venuta in mente qualche tempo fa, sia mai stata avanzata da altri. Tuttavia non la trovo soddisfacente.

Punti a favore:

- Somiglianza semantica: I due termini, maranza e maranga, indicano in effetti la stessa cosa o quasi.

Obiezioni:

- Problemi di diffusione: Il termine maranga, maranca, tipico di Roma, sembra essere del tutto estraneo al Nord, mentre maranza si usa nel Nord, essendo nel Sud soltanto un raro articolo di importazione.

- Problemi morfologici: Non si capisce il motivo del cambiamento del suffissoide -anga, -anca in -anza.

iv) Possibile etimologia: maranza è una pura e semplice alterazione espressiva del veneto marangón "falegname".

Semantica:

"falegname" > "individuo grossolano" > "uomo mal vestito" > "tamarro"

Obiezioni:

- Problemi semantici: Sembra che il passaggio da "falegname" a "uomo mal vestito" sia molto artificioso. Non si capisce perché il gergo abbia tratto ispirazione proprio dai falegnami anziché dai muratori o da altri lavoratori manuali.

- Problemi morfologici: Non si capisce il motivo della sostituzione della finale -angón con un suffissoide -anza.

Nota:

L'etimologia di marangón "falegname" è in ogni caso connessa con quella di maranga, maranca "teppistello" (vedi sopra).

Esistono altre ipotesi, ancor meno probabili, che sembrano essere varianti di quelle sopra esposte. Così si immaginano derivazioni da tamarro + zanza o dalla locuzione marmaglia di zanza. Sono tutte formazioni incredibilmente cervellotiche e vane, più o meno come dire che il panino è il pane di Nino.

Ipotesi filogenetiche:

la tamarrizzazione dei Paninari

Il primo germe si sarebbe sviluppato negli ultimi anni della diffusione dei Paninari, poco prima della loro repentina estinzione. Nella guerriglia urbana a Milano, era in uso tra i tamarri la rapina degli abiti ai paninari nel corso di agguati notturni: questi outfit erano poi esibiti come trofei. Si cominciarono così a formare gli pseudo-paninari. A questi si aggiunsero numerosissimi imitatori che andavano in giro con outfit farlocchi, ad esempio il Fintcler e le Finterland. In pratica erano tamarri con abiti e atteggiamenti paninareschi. Quando la subcultura paninara subì il tracollo, consumata dall'autolisi, il vuoto fu riempito dai maranza. La ricomparsa della subcultura maranza nel XXI secolo, con nuove connotazioni violente e inquietanti, ha spiazzato un po' tutti - soprattutto perché i più giovani attuali non ricordano l'esistenza dei tamarri novecenteschi, che al massimo potevano essere un problema estetico, senza grandi turbamenti dell'ordine sociale (basso potenziale criminogeno). Si può dire che la stessa parola maranza sia entrata in quiescenza verso il 2000, restandovi per tutti i successivi 15 anni. Il fenomeno somiglia allo scorrere di un fiume carsico, che scava a lungo nel sottosuolo per poi scaturire in superficie. Molti sono convinti che non esista relazione alcuna tra i primi maranza e i bulli marocchini attualmente imperversanti, che avrebbero adottato il loro nome tramite un processo di appropriazione culturale (alto potenziale criminogeno).

Jovanotti è stato il Proto-maranza

(e l'inventore del termine)

In assoluto, il primo maranza è stato Jovanotti, ossia Lorenzo Cherubini (Roma, 1966 - vivente), che non sembra affatto essere un "abbronzato". I suoi genitori Mario Cherubini (1934 - 2015) e Viola Cardinali (1935 - 2010), erano toscani di Cortona (prov. di Arezzo). I caratteri somatici puntano a una chiara origine longobarda della stirpe.

Era il 1989. Durante la trasmissione Serata d'onore, condotta da Pippo Baudo, Celentano intervistò Jovanotti e gli chiese informazioni sul significato del termine "maranza", che andava diffondendosi e incuriosiva. La risposta del rapper è stata confusa, sfocata, addirittura surreale: in pratica non è stato in grado di spiegare in termini razionali e comprensibili cosa si dovesse intendere per "maranza". L'interessante video è presente su YouTube:

Visionando le sequenze, possiamo notare questo: Celentano, ignorando la parola, dapprima pronuncia /ma'rantsa/, con lo stesso suono sordo di "danza". In altre parole, usa una pronuncia ortografica. Jovanotti invece pronuncia sempre /ma'randza/, con lo stesso suono sonoro di "manza". Quasi subito, nel corso dell'intervista, Celentano capisce la pronuncia corretta e si adatta. Sono dettagli apparentemente futili, eppure li considero importantissimi.

Conclusioni

La soluzione del problema è possibile, anche se non è immediata. Siccome Jovanotti è stato senza alcun dubbio l'inventore della parola maranza, bisognerebbe intervistarlo. Mi riprometto di farlo. Temo però che la creazione lessicale sia stata arbitraria, forse dovuta a qualche fraintendimento nel bel mezzo della musica assordante. Non mi stupirei affatto se venissi a sapere che Jovanotti è sempre stato un po' duro di orecchi, in fondo nella già citata canzone Il capo della banda cantava così:

"Picchiamo sul volume e ci spacchiamo le orecchie

Magari le cambiamo se diventano vecchie

Noi siamo sempre in forma, viaggiamo come un razzo

Comunque se ti droghi sei una testa di cazzo"

Forse nessuno gli ha detto che il rumore ha effetti estremamente nocivi sulla salute, paragonabili a quelli prodotti da una grave tossicosi!